在上一篇文章中,我为大家详细介绍了Stable Diffusion中一个十分有用的插件,名为ADetailer。

Stable Diffusion 必装插件之 ADetailer

这个插件首要用于修正面部问题并为面部和手添加细节。现在,ADetailer包括了14个不同的模型,每个模型都有其共同的用途。我现已对其间大部分模型进行了比照剖析。但有一个特其他模型——DeepFashion,我之前并未介绍,由于它与其他模型有所不同。在这篇文章中,我将详细介绍DeepFashion。

假如你喜爱看视频教程,那么我十分欢迎你观看本文所对应的视频(B站同名帐号):

DeepFashion的核心功用

DeepFashion模型的核心功用是处理服装。这个模型的数据集包括来自13个盛行服装类其他80多万件服装。运用DeepFashion模型,ADetailer能够检测图画中的服装,并进行切割,以便进行独自处理。

咱们都知道,Stable Diffusion的自然语言了解能力较弱,无法与DALL-E和Midjourney相提并论。例如,运用SDXL模型生成的这张图片,其提示词是“1位女孩,面带微笑,晨光打在脸上,黑色丝质吊带衫,领口处有精美的蕾丝边,酒红色格子高腰半身裙,全身拍摄,凉鞋,古色古香的鹅卵石街道,景深,虚化”。可是,女孩裙子上的格子图画并没有被体现出来。提示词越长,遗漏的细节就越多。

而运用DeepFashion后,能够看到明显的改善,如裙子上的格子图画就被准确体现出来了。

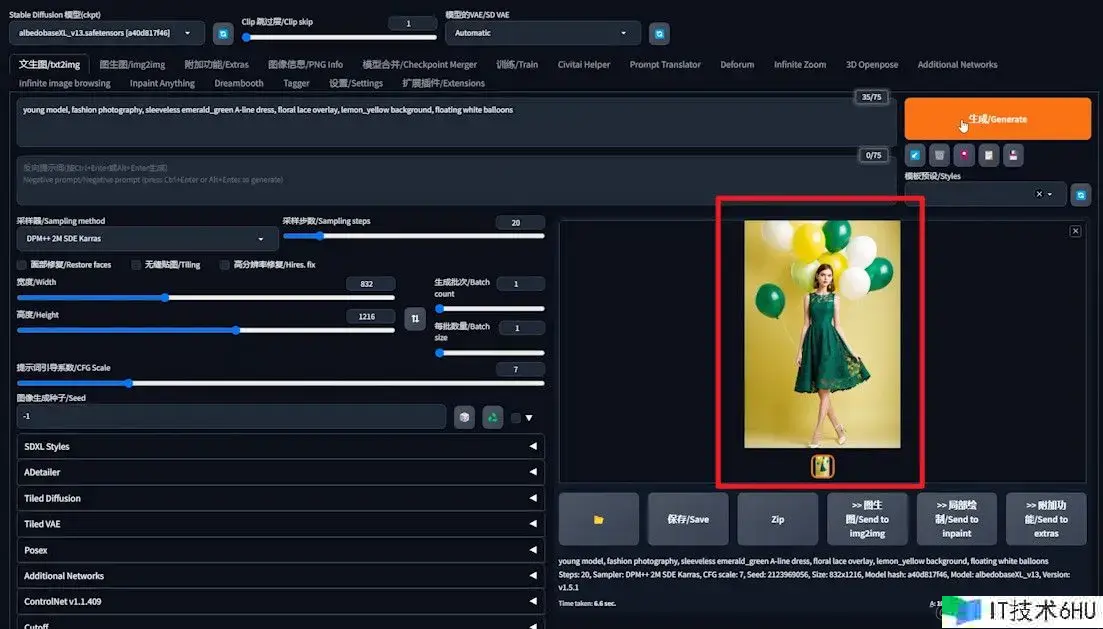

再比方,处理提示词污染的问题。例如,一张图片的布景是柠檬黄色,但Stable Diffusion可能会过错地将柠檬图画运用到女孩的裙子上,如下图所示:

这时,运用DeepFashion能够有效处理这一问题。它会将裙子独自别离出来,并运用专门的提示词进行描绘。这样,假如提示词中不包括“柠檬”,裙子上就不会呈现柠檬图画。

装置DeepFashion模型

以下是DeepFashion模型的详细装置进程:

1️⃣Adetailer插件装置

首要,保证现已装置了Adetailer插件。假如没有装置,能够参考上一篇文章中的进程进行装置。装置Adetailer是运用DeepFashion的前提条件。

2️⃣下载DeepFashion模型

装置Adetailer插件后,DeepFashion模型不会主动呈现在模型列表中。要运用DeepFashion,您需要手动下载它。模型的下载链接是:

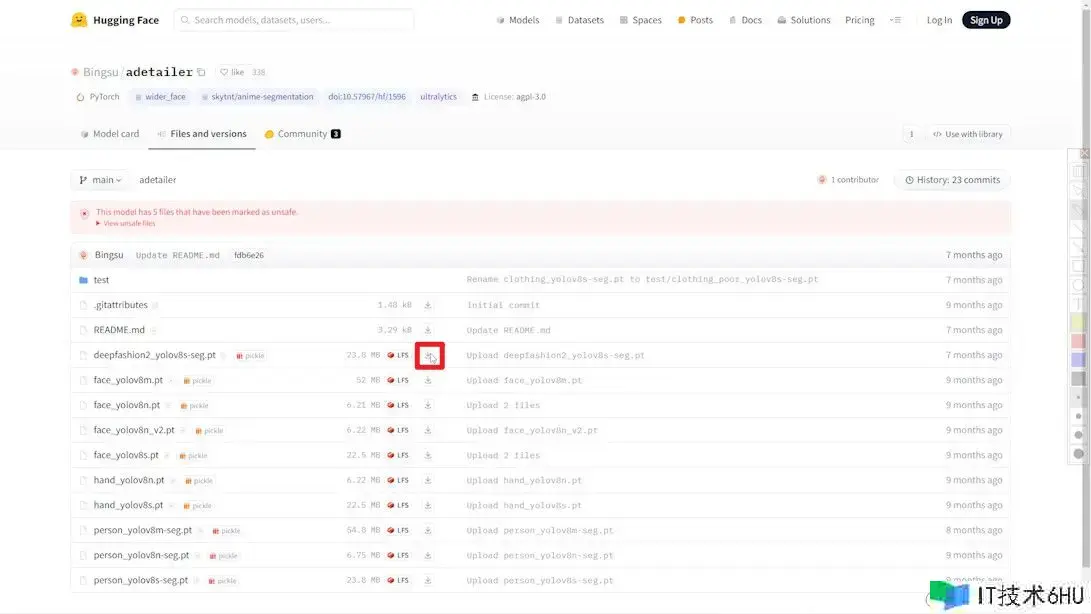

3️⃣进入下载页面

在浏览器中输入下载地址后,你将被引导至HuggingFace下载页面。在这里,一切可用的模型都会被列出,你能够找到坐落列表首位的DeepFashion模型。周围有一个下载按钮,点击该按钮开端下载。

4️⃣移动模型文件

下载完结后,将下载的模型文件移动到Stable Diffusion的 “webui/models/adetailer” 文件夹内。这一进程是必要的,以保证WebUI能够正确辨认并加载模型。

5️⃣重启WebUI

将DeepFashion模型文件放置在正确的文件夹后,需要重启WebUI。重启后,DeepFashion模型应该呈现在Adetailer的模型列表中,这意味着它现已预备好运用了。

装置完结以后,让咱们经过两个事例,感同身受,体验DeepFashion的用法。

事例一:运用DeepFashion处理衣物图画问题

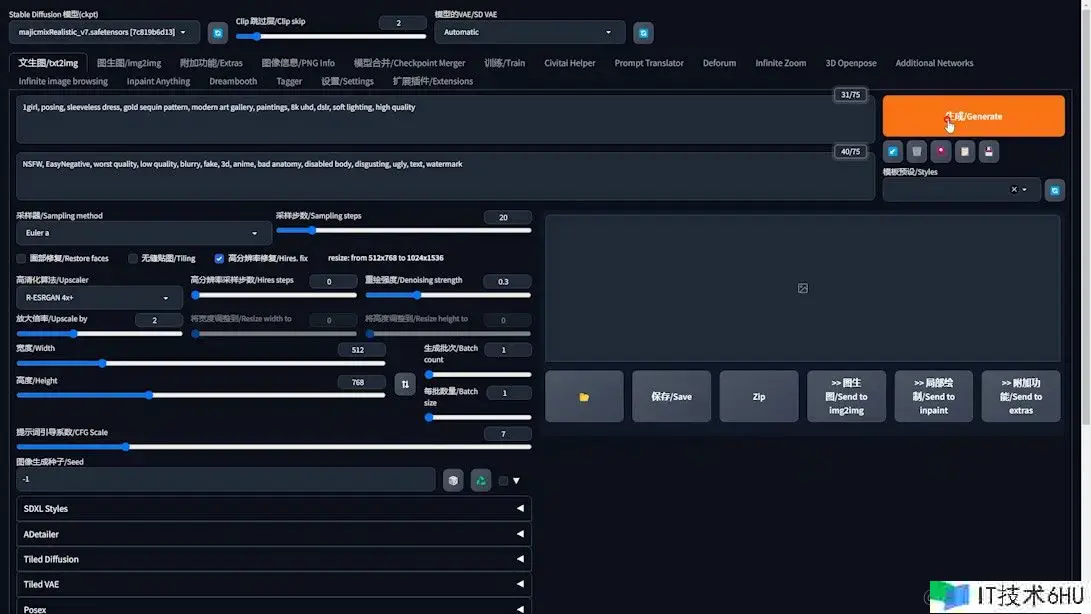

1️⃣ 生成初始图片:

- 翻开WebUI界面。

- 挑选模型:“MajicmixRealistic”(在下一个事例中将运用SDXL模型)。

- 提示词内容:“在现代艺术画廊里穿着亮片裙子的女孩儿”。

- 根据需要调整其他参数。

- 点击“生成”查看作用。

为了更好地说明问题,我生成了几张不同的图片。从中选取了三张展示出来。能够看到,衣服上的亮片或金色部分过错地呈现在了布景中。

2️⃣ 运用DeepFashion处理问题:

- 首要生成一张衣服上没有亮片图画的底图。

- 指定裙子的色彩为黄色,以防止生成黑色裙子导致亮片不明显。

- 将“gold sequin pattern”从提示词中剪切出来,稍后在Adetailer中运用。

- 先不勾选Adetailer插件。

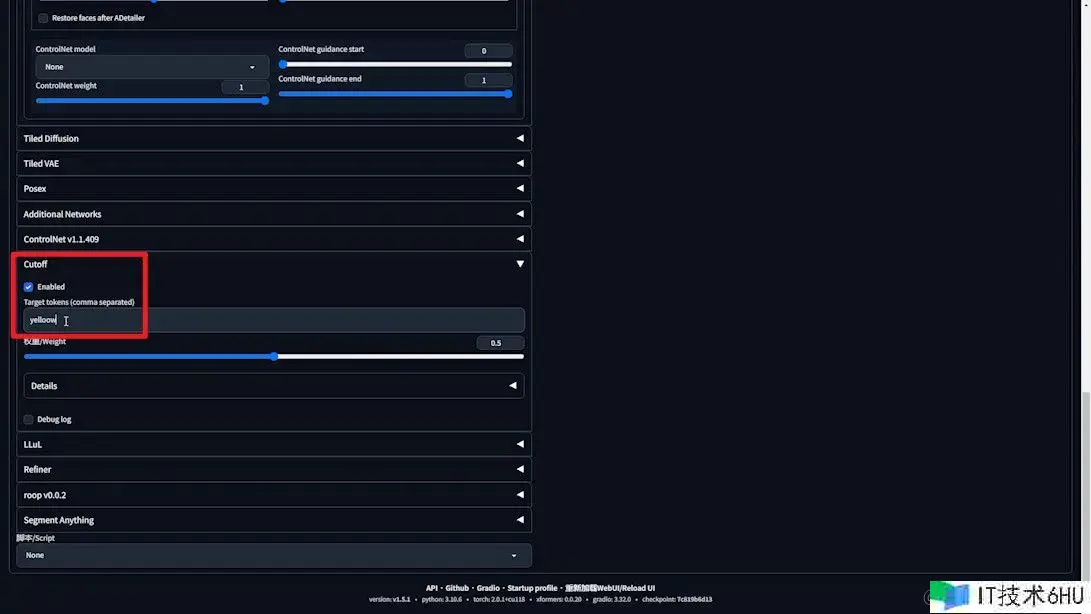

- 如遇提示词污染问题,将黄色添加到Cutoff插件中,保证布景不会呈现金色亮片。

- 生成底图。

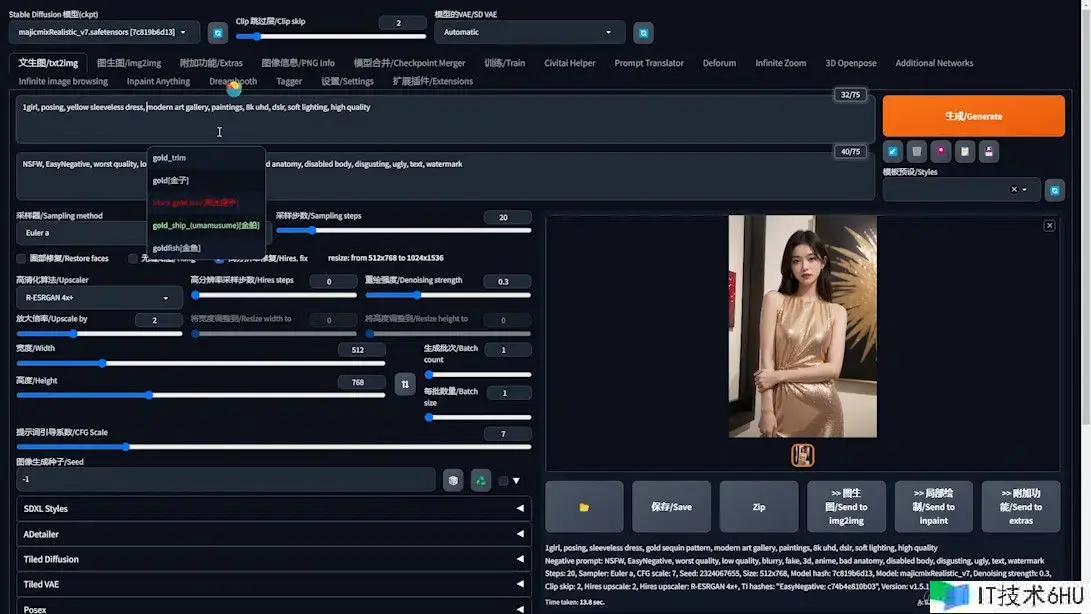

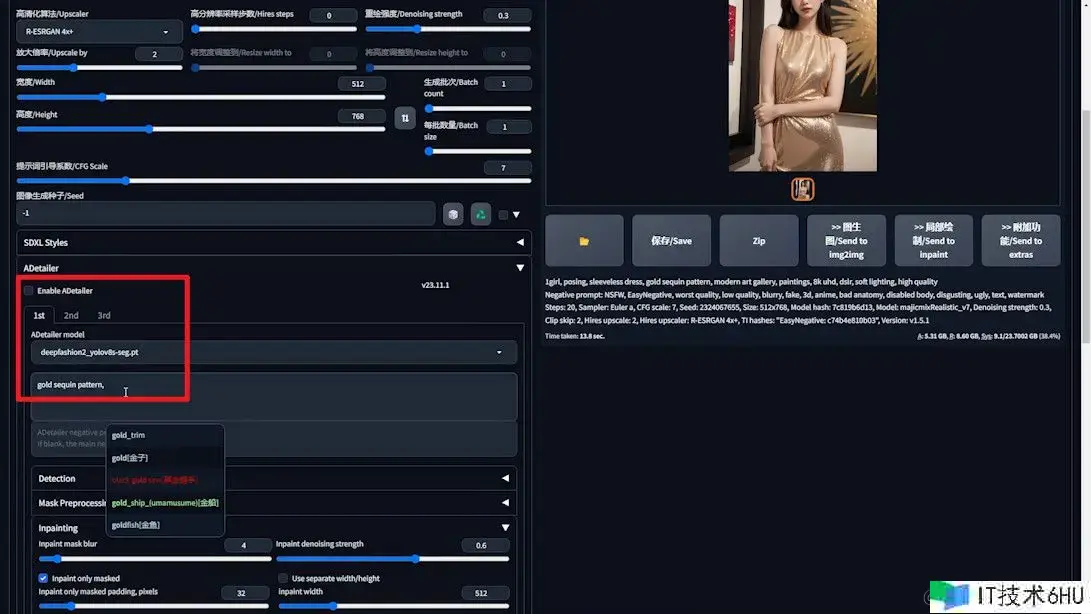

3️⃣ 添加亮片作用:

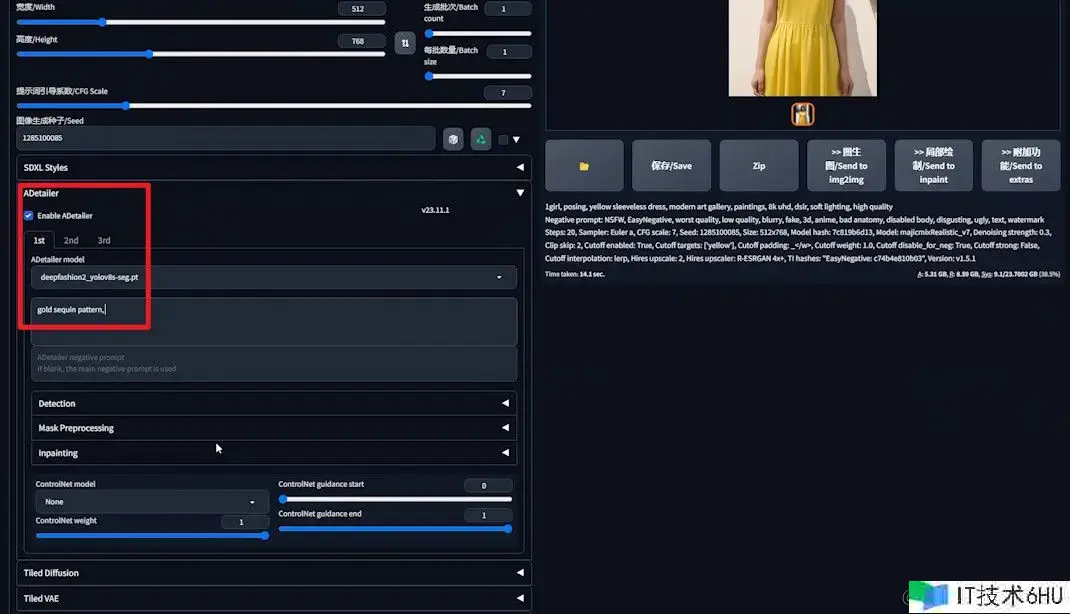

- 固定随机种子,勾选Adetailer插件。

- 在Adetailer的模型列表里挑选DeepFashion。

- 运用方才剪切的“gold sequin pattern”作为提示词。

- 打开“Inpainting”设置,调整“Inpaint denoising strength”(重绘去噪强度)至0.6。

-

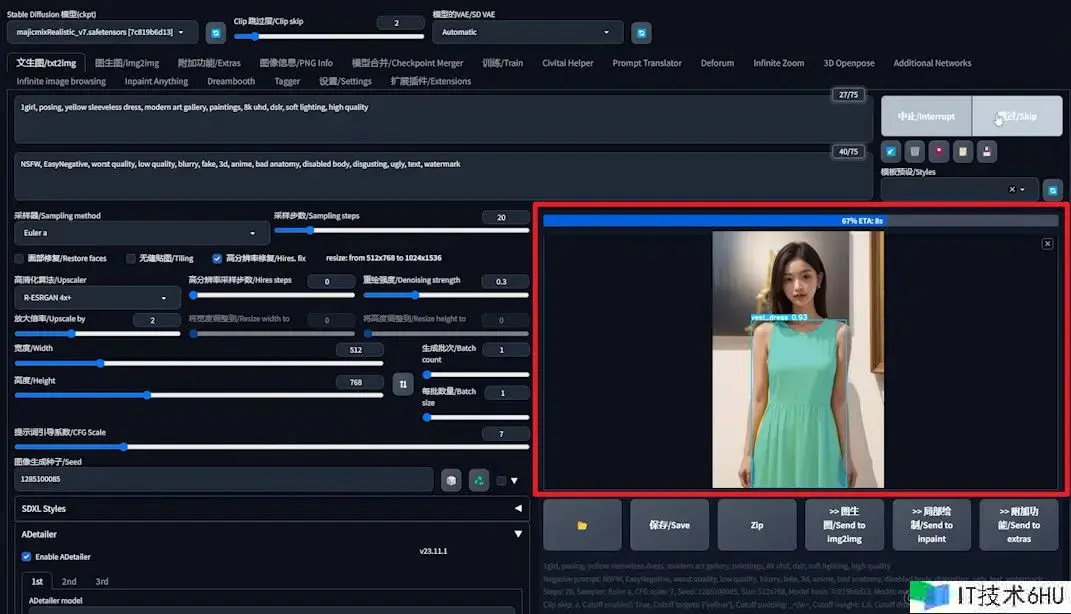

生成图片,并观察进程:

- Stable Diffusion首要根据随机种子生成底图。

- DeepFashion接管,辨认裙子,并对其进行标示和处理。

4️⃣ 调整去噪强度以改善作用:

- 假如亮片作用缺乏,可将去噪强度调至0.7再生成,观察作用。

- 如需更多亮片,继续将参数调至0.8。

事例总结

DeepFashion能够有效地将服装从图片中别离出来进行独自处理,处理了提示词污染问题。这种技术特别适用于那些Stable Diffusion可能无法准确了解和渲染的复杂场景。

例如,运用albedobaseXL模型生成的图片中,绿色的裙子和柠檬黄的布景被准确别离,没有呈现混杂。

而运用dreamshaperXL-Turbo模型生成的图片就呈现了问题,布景中的柠檬黄色过错地呈现在了裙子上。

在这种情况下,DeepFashion就显现出了其优越性,能够准确地处理和优化图片中的服装元素。

经过这个事例,咱们能够看到,DeepFashion不只提高了Stable Diffusion生成图画的质量,也为咱们在图画生成进程中供给了更多的控制和创造力。

事例二:优化SDXL模型中的色彩处理

在Stable Diffusion的运用中,尤其是运用SDXL模型时,咱们经常遇到提示词污染问题,特别是在处理色彩时。让咱们经过一个实践事例,探究怎么运用DeepFashion来处理这一应战。

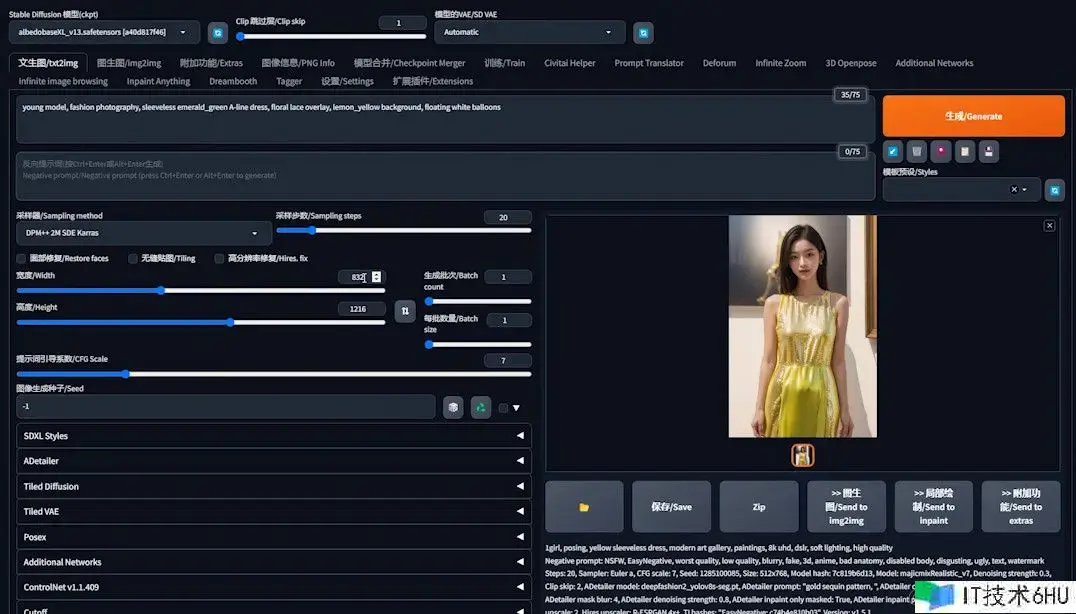

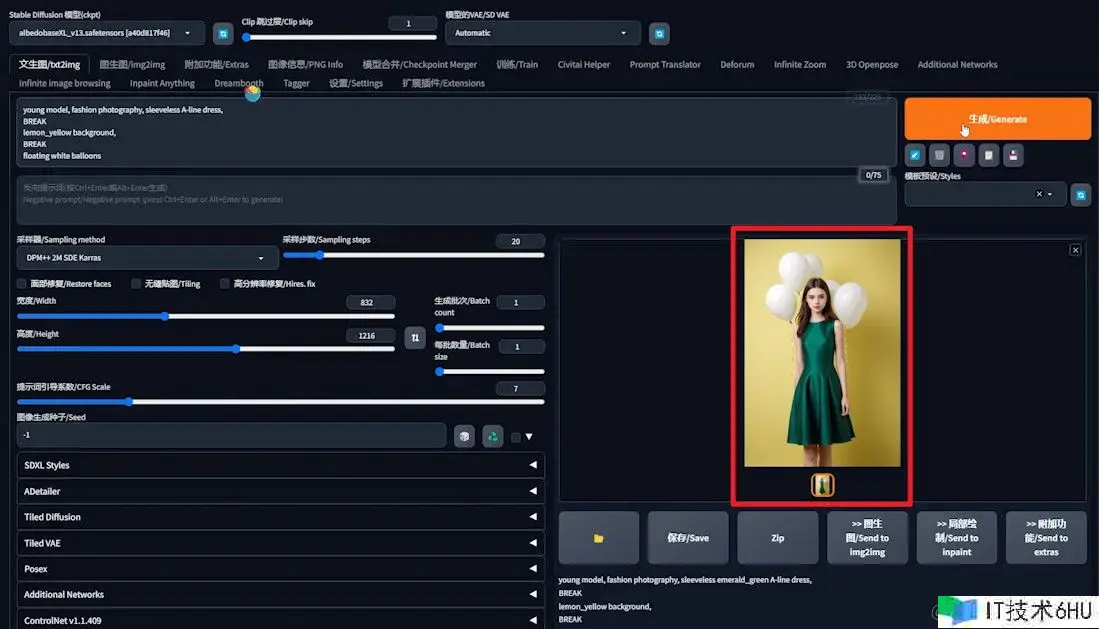

1️⃣ 设置与生成开始图片:

- 模型挑选:更换为SDXL模型。

- 提示词设定: “年轻模特,时髦摄影,无袖祖母绿 A 字连衣裙,花朵蕾丝装修,柠檬黄布景,漂浮的白色气球”。

- 分辨率:设为832×1216。

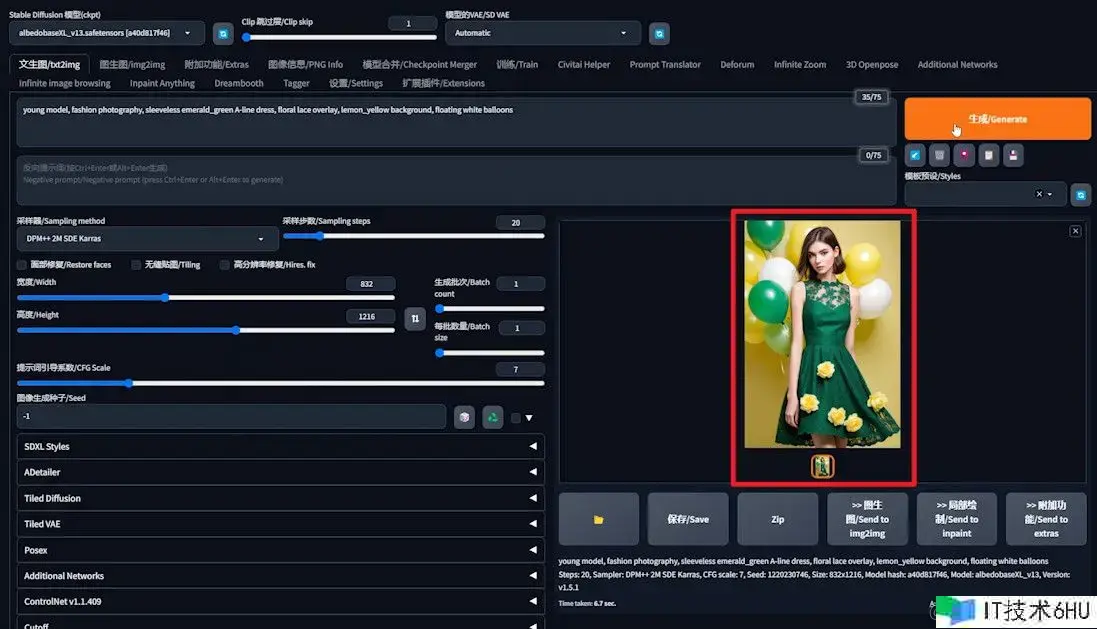

- 生成成果:期望得到的是白色气球,但图片中呈现了黄色和绿色的气球。

2️⃣ 重复生成以寻求改善:

- 第一次重新生成:去除了绿色气球,但仍有黄色气球。

- 第二次重新生成:问题更加夸张,裙子上呈现了花朵。

经过这个事例,咱们看到了SDXL模型在处理特定色彩和元素时的应战。尽管重复生成图片可能会带来一些改善,但成果仍然不稳定,且不契合咱们的预期。为了处理这一问题,DeepFashion插件就显得尤为重要。

在接下来的内容中,我将展示怎么运用DeepFashion来准确控制图画中的色彩元素,保证生成的图画更加契合咱们的预期。

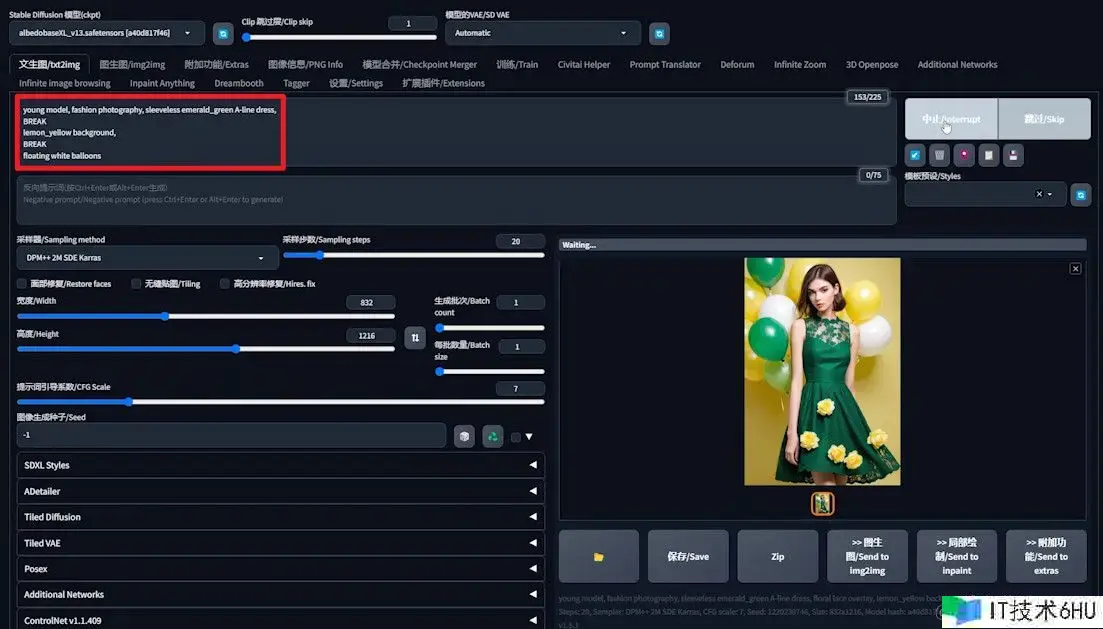

3️⃣ 测验运用“BREAK”关键词:

- 简化提示词:去掉“蕾丝装修”。

- 在“裙子”和“柠檬黄布景”之后参加“BREAK”关键词。

- 生成成果:呈现了黑色气球,布景色彩过错。

2️⃣ 多次测验改善:

- 再次生成:裙子和气球色彩正确,但布景色仍然不准确。

- 最后一次测验:色彩总算正确,但办法不稳定,依靠运气。

咱们用抽卡的方式实现了想要的作用。可是能够看到,这种办法不稳定,得靠运气。接下来咱们用DeepFashion实现更可控的作用。

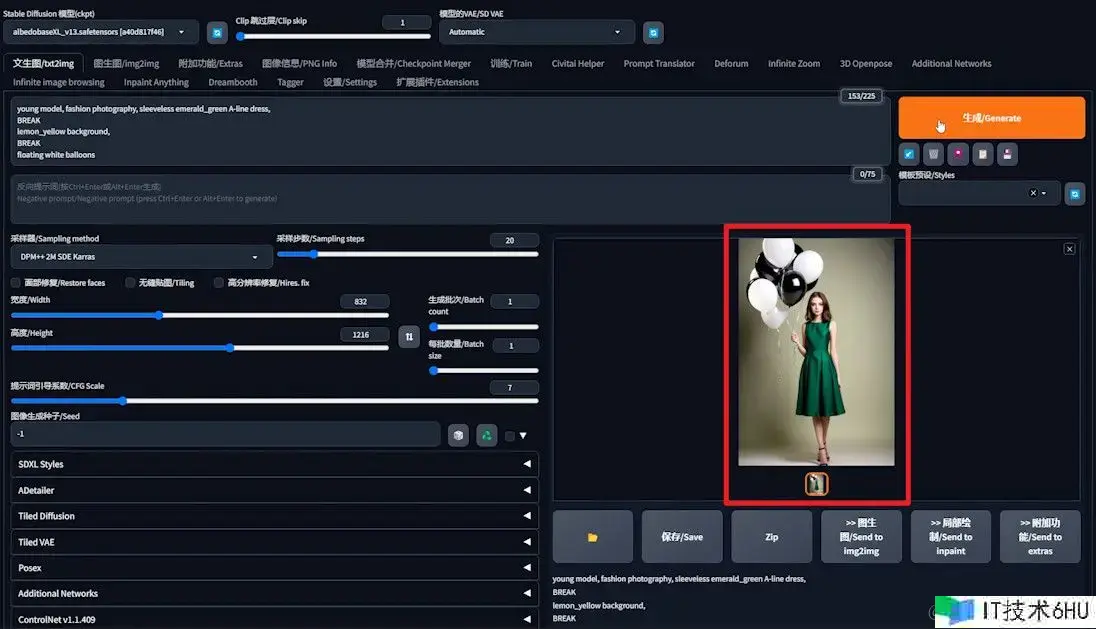

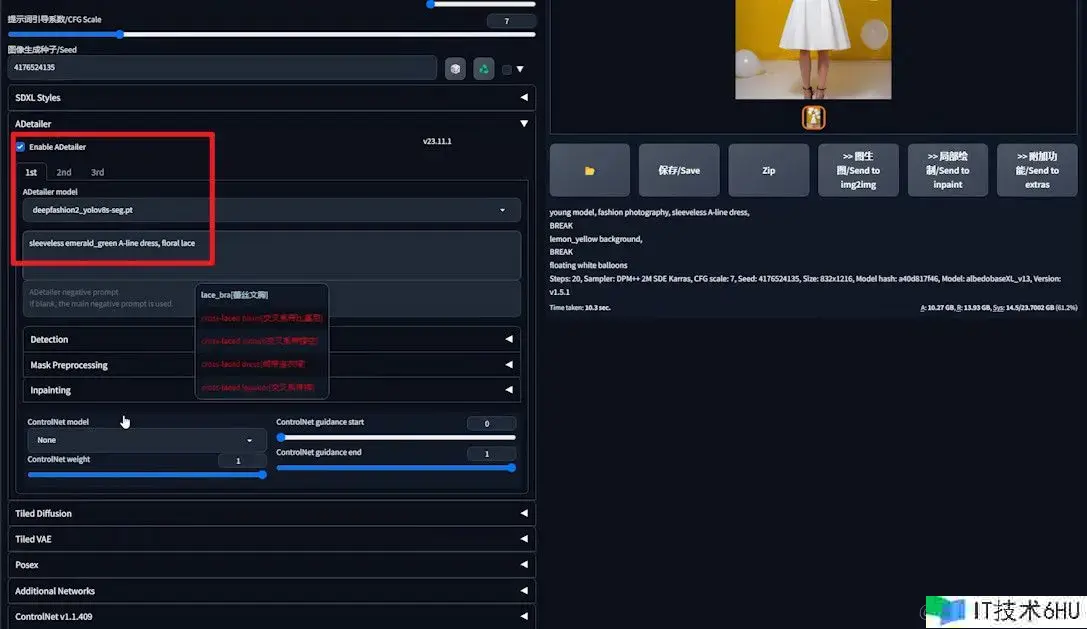

1️⃣ 预备阶段:

- 删去提示词中的“祖母绿”,预备稍后经过DeepFashion进行调整。

- 生成图片,保证布景和气球色彩正确。

2️⃣ 运用DeepFashion处理衣服:

- 固定随机种子。

- 启用Adetailer插件,挑选DeepFashion模型。

- 添加描绘:“祖母绿无袖 A 字裙,花朵蕾丝”。

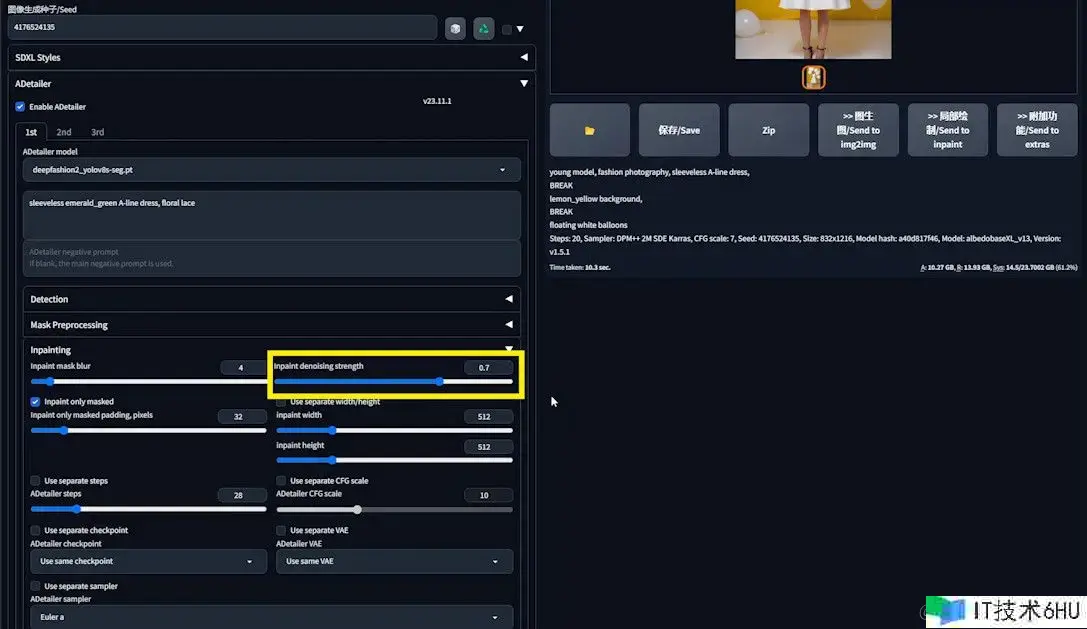

- 调整“Inpaint denoising strength”至0.7,然后生成。

- 观察到裙子色彩首要仍是白色。

3️⃣ 增强作用:

- 提高“Inpaint denoising strength”至0.8,再生成。

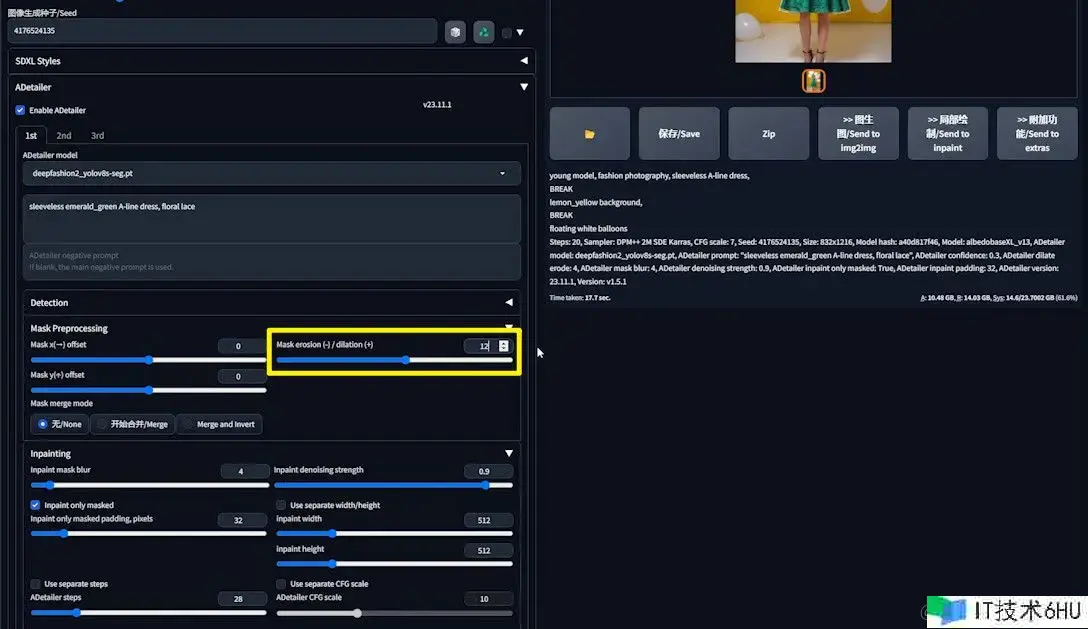

- 测验运用更高的0.9值,裙子变为祖母绿色,但边际仍有白色残留。

4️⃣ 微调蒙版处理:

- 调整“Mask Preprocessing”中的“Mask erosion/dilation”参数。

- 将蒙版扩张设为12,生成图片,白边减少。

- 进一步调整至16,简直消除了一切白边。

结论与运用

DeepFashion作为Adetailer中的一个共同模型,能够独立处理服装,从而防止提示词污染问题,一起为服装添加细节。它不只支撑SD1.5模型,还支撑SDXL模型。当你需要处理服装时,DeepFashion是一个值得考虑的挑选。

OK,以上便是本期的内容。期望这篇文章对你有所协助。假如你觉得有用,不妨给我点个赞。

对AI绘图感兴趣的,欢迎加我微信vito_chat入群沟通。

欢迎拜访我的免费学习AI网站:

原文地址: