最近一直在看大模型 RAG 技术相关,前面写过一篇文章# 打开 RAG 对接大模型的黑盒 —— 9 大隐藏问题 可以看到 RAG 技术还有很多痛点,本篇再深入一步,思考一些解决方法~

闲话少说,直接开冲!

为什么是 RAG?

通俗来理解,RAG 就是给大模型加一个物理外挂,通过它来给大模型加持专业知识。

思路:构建几十万量级的数据,然后利用这些数据对大模型进行微调,以将额外知识注入大模型;

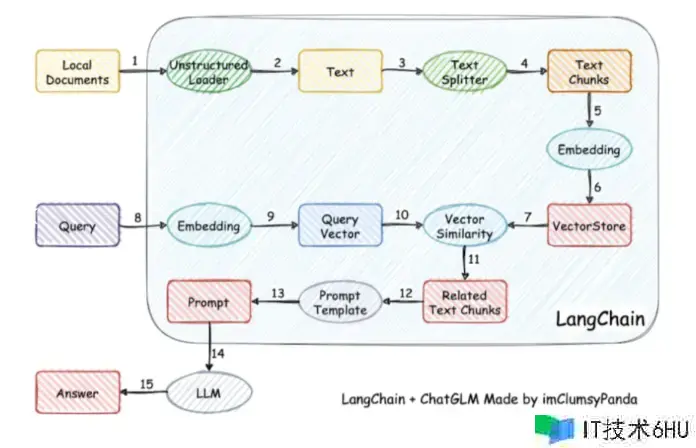

具体实现:加载文件 => 读取文本 => 文本分割 =>文本向量化 =>问句向量化 =>在文本向量中匹配出与问句向量最相似的 top k 个 =>匹配出的文本作为上下文和问题一起添加到 prompt 中 =>提交给 LLM 生成回答

RAG 优点呢就是简单粗暴,缺点就是这几十万量级的数据训练成本高,且融入到大模型的程度有限。

RAG 核心就是将用户知识库内容经过 embedding 存入向量知识库,然后用户每一次提问也会经过

embedding,利用向量相关性算法(例如余弦算法)找到最匹配的几个知识库片段,将这些

知识库片段作为上下文,与用户问题一起作为 promt 提交给 LLM 回答。

RAG 痛点和解决

Q1

1、文档切分粒度不好把控,既担心噪声太多又担心语义信息丢失;

可以看这篇文章:# 基于LLM 向量库的文档对话痛点及解决方案 把这个问题解析的很到位;

Q2

2、在基于垂直领域表现不佳:主要在于一个是对 embedding 模型的基于垂直领域的数据进行微调;一个是对LLM 基于垂直领域的数据进行微调;

Q3

3、langchain 内置问答分句效果不佳;

一种是使用更好的文档拆分的方式(如项目中已经集成的达摩院的语义识别的模型及进

行拆分);一种是改进填充的方式,判断中心句上下文的句子是否和中心句相关,仅添加相关度高

的句子;另一种是文本分段后,对每段分别及进行总结,基于总结内容语义及进行匹配;

Q4

4、如何尽可能召回与 query 相关的 Document 问题?

将本地知识切分成 Document 的时候,需要考虑 Document 的长度、Document embedding 质

量和被召回 Document 数量这三者之间的相互影响。

在文本切分算法还没那么智能的情况下,本地知识的内容最好是已经结构化比较好了,各个段落之间语义关联没那么强。Document 较短的情况下,得到的 Document embedding 的质量可能会高一些,通过 Faiss 得到的 Document 与 query 相关度会高一些。

Q5

5、如何让 LLM 基于 query 和 context 得到高质量的 response ?

尝试多个的 prompt 模版,选择一个合适的,但是这个可能有点玄学;用与本地知识问答相关的语料,对 LLM 进行 Finetune。

Q6

6、embedding 模型在表示 text chunks 时偏差太大问题;

一些开源的 embedding 模型本身效果一般,尤其是当 text chunk 很大的时候,强行变成一个简单的 vector 是很难准确表示的,开源的模型在效果上确实不如 openai Embeddings;

多语言问题,paper 的内容是英文的,用户的 query 和生成的内容都是中文的,这里有个语言之间的对齐问题,尤其是可以用中文的 query embedding 来从英文的 text chunking embedding 中找到更加相似的 top-k 是个具有挑战的问题

解决方法是用更小的 text chunk 配合更大的 topk 来提升表现,毕竟 smaller text chunk 用 embedding 表示起来 noise 更小,更大的 topk 可以组合更丰富的 context 来生成质量更高的回答;

多语言可以找一些更加适合多语言的 embedding 模型;

Q7

7、不同的 prompt,可能产生完全不同的效果问题;

prompt 是个神奇的东西,不同的提法,可能产生完全不同的效果。尤其是指令,指令型 llm 在训练或者微调的时候,基本上都有个输出模板,这个如果前期没有给出 instruction data 说明,需要做很多的尝试,尤其是希望生成的结果是按照一定格式给出的,需要做更多的尝试;

Q8

8、生成效果问题;

LLM 本质上是个“接茬”机器,你给上句,他补充下一句。

各家的 LLM 在理解 context 和接茬这两个环节上相差还是挺多的。

可以选择一些好玩的开源模型,比如 llama2 和 baichuan2,然后自己构造一些 domain dataset,做一些微调的工作,让 llm 更听你的话

Q9

9、如何更高质量地召回 context 喂给 llm;

解决方法:用更加细颗粒度地来做 recall,当然如果是希望在学术内容上来提升质量,学术相关的 embedding 模型、指令数据,以及更加细致和更具针对性的 pdf 解析都是必要的。

RAG 模块优化

从 RAG 的工作流中看,RAG 模块有:文档块切分、文本嵌入模型、提示工中、大模型生成。

不同模块,策略不同:

文档块切分:设置适当的块间重叠、多粒度文档块切分、基于语义的文档切分、文档块摘要。

文本嵌入模型:基于新语料微调嵌入模型、动态表征。

提示工中优化:优化模板增加提示词约束、提示词改写。

大模型迭代:基于正反馈微调模型、量化感知训练、提供大 context window 的推理模型。 还可对 query 召回的文档块集合进行处理,如:元数据过滤、重排序减少文档块数量。

……

RAG 还有一些架构优化策略,比如利用 知识图谱(KG)进行上下文增强、如何让大模型对召回结果进行筛选、以及引入多向量检索器等。

后续有机会再研究研究~~

OK,以上就是本次分享,欢迎点赞、收藏⭐、评论

说到这里,我们不难发现:成长与发展是主旋律!!自荐我和机械工业出版社联合出版的 《程序员成长手记》一书:全书分为3大模块、8个章节:从入门程序员到程序员自驱成长,回归纸质阅读,相信能给你一个更全局的程序员视野,提供成长帮助。京东搜“程序员成长手记”

关注安东尼 ,陪你一起度过漫长编程岁月