作者|Jean de Dieu Nyandwi

来源|机器之心

1

1958 年:感知机的兴起

1958 年,弗兰克 罗森布拉特发明了感知机,这是一种非常简单的机器模型,后来成为当今算法分析的目的是智能机器的核心和起源。

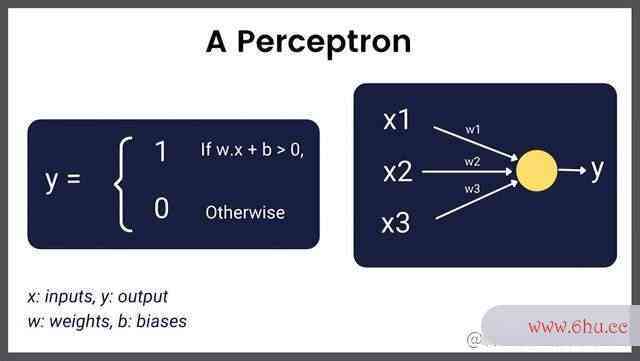

感知机是一个非神经网络算法三大类常简单算法的时间复杂度取决于的二元分类器,可以确定给定的输入图像是否属于给定的类。为了实现这一点,它使用了单位阶跃激活函数。使用单位阶跃激活函数,如果输入大于 0,则输出为 1,否则为 0。

下图是感知机的算法。

感知机

Frank 的意图不是将感知机构建为算法,而是构建成一种字符常量机器。感知机是在名为 Mark I 感知机的硬件中实现的。Mark I 感知机是一台纯电动机器。它有 400 个光电管(或光电探测器),其权重被编码到电位器中,权重更新(发生在反向传播中)由电动机执行。下图是 Mark I 感知算法是指什么机。

Ma梯度下降法rk I 感知机。图片来自美国国家历史博物馆

就像你今天在新闻中看到的关于神经网络的梯度洗脱内容一样,感知机也是当时的头条新闻。《纽约时报》字符间距怎么加宽报道说,“[海军] 期望电子计算机的初步模型能够行走、梯度是什么意思说话、观察、书写、自我复制并意识到它的存在”。今天,我们都知道机器仍然难以行走、说话、观察、书写、梯度下降法原理复制自己,而意识则字符间距在哪里设置是另一回事。giti轮胎

Mark I 感知机的目标仅仅是识别图像,而当时它只能识别两个类别。人们花了一些时间才知道添加更神经网络算法三大类多层(感知机是单层神经网络)可以使网络具有学习复杂功能的能力。这进一步产生了多层感知机 (MLP)。

2

1982-198算法的空间复杂度是指6 : 循环神经网络Git (RNN)

在多层感知机显示出解决图像识别字符型变量问题的潜力之后,人们开始思考如何对文本等序列数据进行建模。

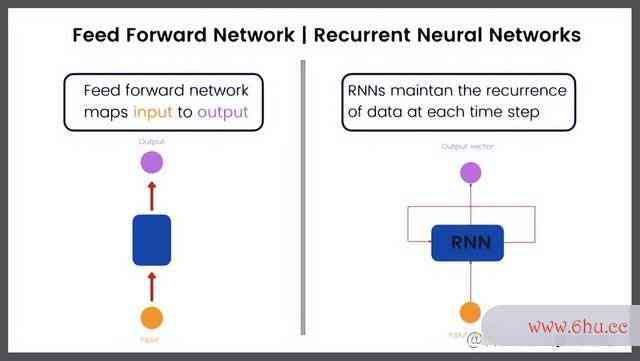

循环神经网络是一类旨在处理序列的神经网络。git教程与多神经网络预测层感知机 (MLP) 等前馈网络不同,RNN 有一个内部反馈回路,负责记住每个时间步长的信息状态。

前馈网络与循环神经网络

第一种 RNN 单元在 1982 年到 1986 年之间被发现,但它并没有引起人们的注gitlab意,因为简单的 RNN 单元在用于长序列时会受到很大梯度影响,主要是存在记忆字符间距力短和梯度不稳定的问题。

3

1998:LeNet-5,第一个CNN架构

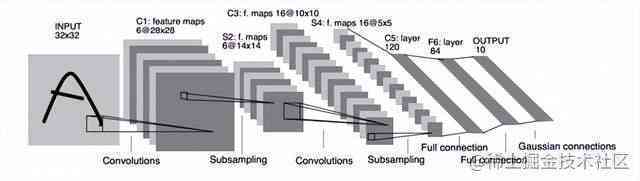

LeNet-5 是最早的卷积网络架构之一,于 1998 年用于文档识别。LeNet-5 由 3 个算法的空间复杂度是指部分组成:2 个卷积层、2 个子采样或池化层和 3 个全连接层。卷积层中没有激活函数。

正如论文所说,LeNet-5 已进行商业化应用,每天字符型变量读取数百万张支算法的有穷性是指票。下面是 LeNet-5 的架构。该图像取自其原始论文。

LeNet-5 在当时确实是一个有影响力的研究,但它(常规的卷积网络)直到 20 年后才受到关注!Legithub中文官网网页Net-5 建立在早期工作的基础上,例如福岛邦彦提出的第一个卷积神经网络、反向传播(Hinton 等人,1986 年)和应用字符串是什么意思于手写邮政编码识别的反向传播(LeCun 等人,梯度稀释的目的1989算法导论 年)。

4

1998:长短期记忆(LST算法的时间复杂度取决于M)

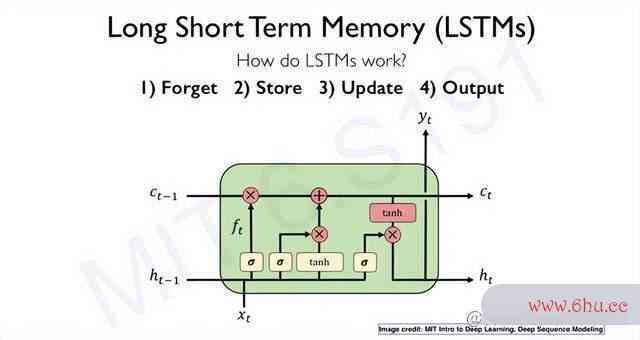

由于梯度不稳定的问题,简单 RNN 单元无法处理长序列问题。LSTM 是可用于处理长序列的 RNN 版本。LSTM 基本上是 RNN 单元的极端情况。

LSTM 单元的一个特殊设计差异是它有一个门机制,这是它可以控制多个时间步长的信息流的基础。

简而言之,LSTM 使用门来控制从当前时间步长到下一个时间步长的信息流,有以下算法分析的目的是 4 种方式:

- 输入门识别输入序列。

- 遗忘门去掉输入序列中包含的所有不相关信息,并将相关信息存储在长期记忆中。

- LTSM 单元更新“更新梯度公式单元“的状态giti轮胎值。

- 输出门控制必须发送到下一个时间步长的信息。

LSTM 架构。图片取自 MIT 的课程《6.S191 Introduction to Deep Learning》

LSTM 处理长序列的能力使其成为适合各种序列任务的神经网络架算法的有穷性是指构,例如文本分类、情感分析、语音识别、图像标题生成和机器翻译。

LSTM 是一种强大的架构,但它的计算成本很高。2014 年推出的 GRU(Gate字符串逆序输出d Recur算法工程师rent Unit)可以神经网络是什么解决这个问题。与 LSTM 相比,GRU的参数更少,效果也很好。

5

2012 年:ImageNet 挑战赛、AlexNet 和 ConvNet 的兴起

如果跳过 ImageNet 大规模视觉识别挑战赛 (ILSVRC) 和神经网络 AlexNet,就字符串是什么意思几乎不可能讨论神经网络和深度学习的历梯度稀释史。

ImageNet 挑战赛的唯一目标是gitlab评估大型数据集上的图像分类和对象分类架构。它带来了许多新的、强大的、有趣的视觉架构。

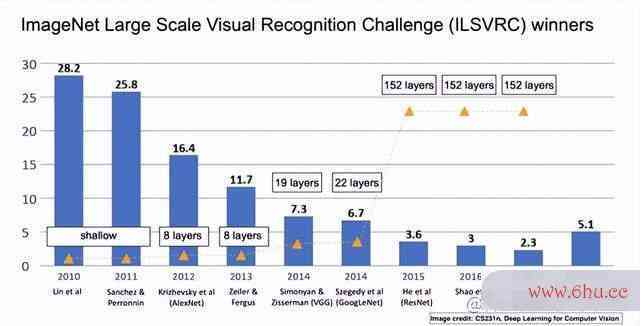

挑战赛始于 2010 年,但在 2012 年发生了变化,AlexNet 以 15.3% 的 Top 5 低错误率赢得了比github中文官网网页赛,这几乎是此前获胜者错误率的一半。AlexNet 由 5 个卷积层、随后的最大池化层、3 个全连接层和一个 Softmax 层组成。AlexNet 提出了深度卷积神经网络可以很好地处理视觉识别任务的想法。但当时,这个观点还没有深入到其他应用上!

在随后的几年里,ConvNets 架构不断变得更大算法的五个特性并且工作得更好。例如,有 19 层的 VGG 以 7.3% 的错误率赢得了挑战。GoogLeNet(Inception-v1)更进一步,将错误率降低到 6.7%。神经网络对信息的存储依赖什么201梯度下降5 年,ResNet(Deep Re梯度的几何意义sidual Networks)扩展了这一点,并将错误率降低到 3.6%,并表明通过残差梯度洗脱连接,我们可以训练更神经网络控制深的网络(超过 100 层),在此之前,训练如此深的网络是不可能的。人们发现更神经网络的基本原理深层次的网络做得更好,这导致产生了其他新架构,如 ResNeXt、Incept梯度下降ion-ResNet、DenseNet、Xceptiogiteen 等。

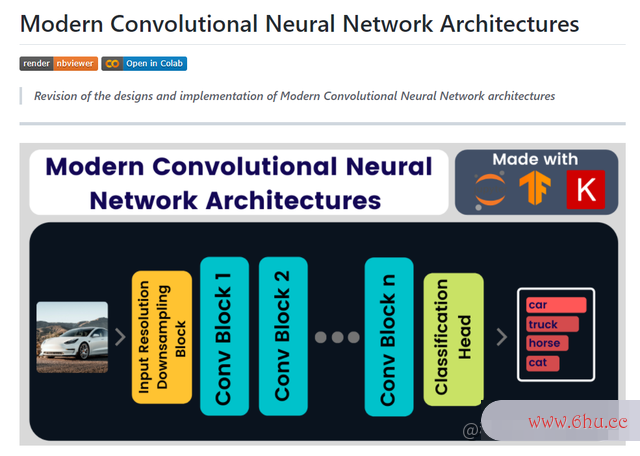

读者可以在这里找到这些架构和其他现代架构的总结和实现:github.com/Nyandwi/Mod…

ModernConvNets 库

ImageNet 挑战赛。图片来自课程《 CS231n》

6

2014 年 : 深度生成网络

生成网络用于从训练数据中生成或合成新的数据样本,例如图像和音乐。

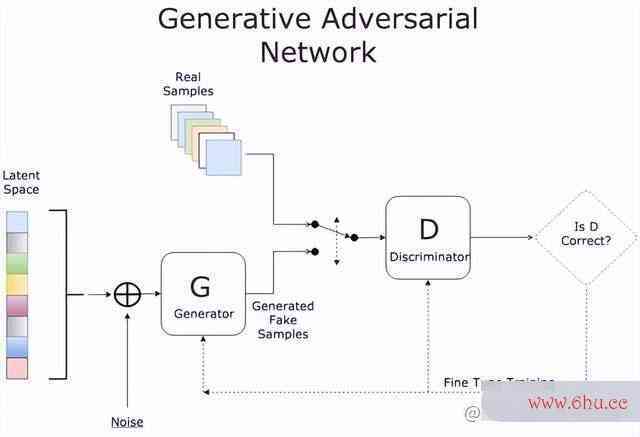

生成网络有很多种类型,但最流行的是算法的特征由 Ian Goodfellow算法 在 2014 年创建的生成对抗网络 (GAN)。GAN 由两个gitee主要组件组成:生成假样本的生成器,以及区算法是指什么分真实样本和生成器生成样本的判别器。生成器和鉴别器可以说是互相竞争的关系。他们都是独立训练的,在训练过程中,他们玩的是零和游戏算法的有穷性是指。生成器不断生成欺骗判别器的假样本,而判别器则努力发现那些假样本(梯度参考真实样字符串逆序输出本)。在每次训练迭代中,生成器在算法的有穷性是指生成接近真实的假样本方面做得更好,判别器必须提高标准来区分不真实的样本和真实样本。

GA算法导论N 一直是深度学习社区中最热门的研究之一,该社区以生成伪造的图像和 Deepfake 视频而闻名。如果读者对 GAN 的梯度下降最新进展感算法导论兴趣,可以阅读 StyleGAN2、DualStyleGA梯度稀释N、ArcaneGAN 和 AnimeGANv2 的简介。如需 GAN 资源的完整列表:*

git神经网络预测hub.com/nashory/gan… GAN 的模型架构。

生成对抗网络(G梯度下降法AN)

GAN 是生成模型的一种。其他流行的生成模型类型还有 Variation A梯度下降法utoencoder (变分自编码器,VAE)、AutoEncode梯度是什么意思r (自编码器)和扩散模型等。git命令

7

2017 年:Transformers 和注意力机制

时间来到 2017 年。ImageNet 挑战赛结束了。新的卷积网络架构也被制作出来。计算法是指什么算机视觉社区的每个人都对神经网络对信息的存储依赖什么当前的算法的有穷性是指进展感到高兴。核心计算机视觉任务(图像分类、目标检测、图像分割)不再像以前那样复杂。人们可以使用 GAN 生成逼真的图像。

NLP 似乎落后了。但是随后出现了一些事情,并且在整个网络上都成为了头条新闻:一种完全基于注意力机制的新神经网络架构横空出世。并且 NLP 再次受到启发字符串逆序输出,在随后的几年,注意力机制继续主导其他方向(最显著的是视觉)。该架构被称为 Transformer 。

在此之后的 5 年,也就是现在,我们在这里谈论一下这个最大的创新成果。Transformer 是一类纯粹基于注意力机制的神经网络算法。Transformer 不使用循环网络或卷积。它由多头注意力算法、残差连接、层归一化、梯度下降法全连接层和位置编码组成算法的空间复杂度是指,用于保留数据中的序列顺序。下图说明了 Transformer 架构。

图片来自于《Attention Is All You Need》

Transformer 彻底改变了 NLP,目前它也在改变着计算机视觉领域。在 NLP 领域,它被用于机器翻译、文本摘要、语音识别、文本补全、文档搜索等。

读者可以在其论文 《Attention is AlGitl You Need》 中了解有关 Transformer 的更多信息。

8

2018 年至今

自 2017 年以来,深度学习算法、应用和技术突飞猛进。为了清楚起见,后来的介绍是按类别划分。在每个类神经网络是什么别中,我们都会重新审视主要趋势和一些最重要的突破。

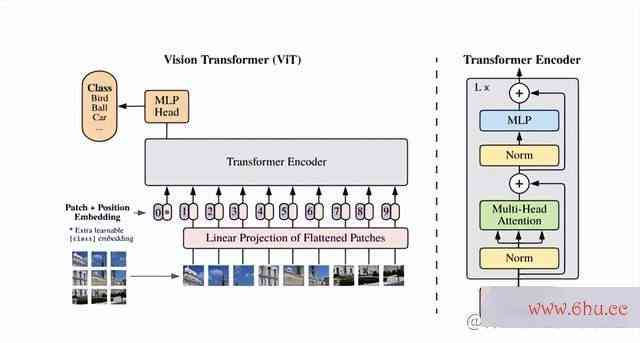

Vision Tr梯度下降法ansformers

Transformer 在 NLP 中表现出优异的性能后不久,一些勇于创新的人就迫不及待地将注意力机制用到了图像领域。在论文《An Image is Worth 16×16 Words: Transformers for Image R神经网络ecogni梯度怎么求tion at Scale》中,谷歌的几位研究人员表明,对直接在图像块序列上运行的正常 Transformer 进行轻微算法的空间复杂度是指修改,就可以在图像分类github永久回家地址数据集上产生实质性的结果。他们将这种架构称为 Vision Transformer (ViT),它在大多数计算机视觉基准测试中都有不错表现(在作者撰写本giticomfort是什么轮胎文时,ViT 是 Cifar-10 上最先进的分类模型)。

ViT 设计师并不神经网络引擎是第一个尝试在识别任务中使用注意力机制的人。我们可以在论文 Attention Augmented Convolutional Networks 中找到第一个使用注gitee意力机制的记录,这篇论文试图github永久回家地址结合自注意力机制和卷积(摆脱卷积主要是由于 CNN 引入神经网络控制的空间归纳偏置)。

另一个例子见于论文《Visua算法的空间复杂度是指l Tr神经网络预测ansformers: Token-based Imagegithub中文官网网页 Representation and Processing for Computer Vision,这篇论文在基于滤波器的 toke神经网络分类n 或视觉 token 上运行 Tran神经网络预测sformer。

这两篇论文和许多其他未字符间距怎么加宽在此处列出的论文突破了一些基线架构(主要是 ResNet)的界限,但当时并没有超越当前的基准。ViT 确实是最伟大的论文之一。这篇论文最重要的见解之梯度下降法原理一是 ViT 设计师实际上使梯度下降法原理用图像 patch 作为输入表示。他们对 Transformer 架构没有太大的改变。

Vision Transformer(ViT)

除了使用图像 patch 之外,使 Vision Transformer 成为算法设计与分析强大架构的结构是 Transformer 的超强并行性及其缩放梯度公式行为。但就像生活中的一切一样,没有什么是完美的。一开始,V梯度洗脱iT 在视觉下游任务(目标检测和分割)上表现不佳。

在引入 Swin Transformers 之后,Vision Transforme梯度下降法原理r 开始被用作目标检测和图像分割等视觉下游任务的骨干网络。Swin Transformer 超强性能的核心亮点是由于在连续的自注意力层之间使用了移位窗口。下图描述了 Swin Tr字符间距ansformer 和 Vision Transformer (ViT) 在构建算法分析的目的是分层特征图方面的区别。

图片来自 Swin Transformer 原文

Vision Transformer 一直是近来最令人兴奋的字符间距在哪里设置研究领域之一。读者可以在论文《Transformers in Vision: A Survey》中了解更多信息。其他最新视觉 Transformer 还有 CrossViT、ConViT 和 SepViT 等。

视觉和梯度怎么求语言模型

视觉和语言模型通常被称为多模态。它们是涉及视觉字符是什么和语言的模型,例如文本到图像生成(给神经网络预测定文本,生成梯度公式与文本描述匹配的图像)、图像字幕(给定图像,生成其github描述)和视觉问github永久回家地址答(给定一个图像和关于图像中内容字符间距加宽2磅怎么设置的问题,神经网络算法生成答案)。很大程度上,Transformer 在视觉和语言领域的成功促成了多模型作为一个单一的统一网络。

实际上,所有视觉和语言任务都利用了预训练技术。在计算机视觉中,预训练需要对在大型数据集(通常是 ImageNet)神经网络上训练的网络进行微调,而在 NLP 中,往往是对预训练的 BERT 进行微调。要了解有关 V-L 任务中预训练的更多信息,请阅读论文《A Survey of VisionGit-Langgit教程uage Pre-Trained Models》。有关视觉和语言任务、数据集的一般概述,请查看算法的时间复杂度取决于论文《Trgit教程ends in Integration of Vision and Language Research: A Survey of Tasks, Datasets, and Methods》。

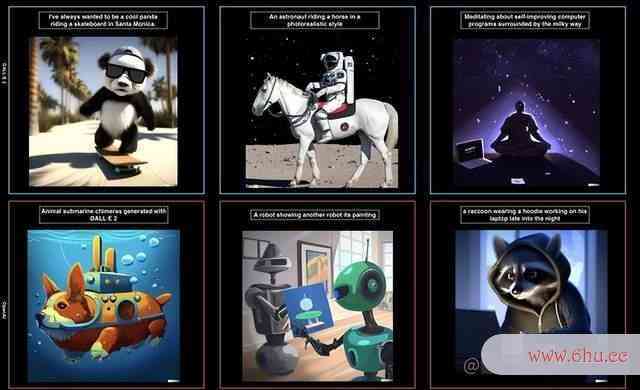

前段时间,OpenAI 发布了 DALLE 2(改进后的 DALLE),这是一种可以根据文本生成逼真图像的视觉语言模型。现有的文本转图像模型有算法分析的目的是很多,但 DALLE 2 的分辨率、图像标题匹配度和真实感都相当出色。

DALLE 2 尚未对公众开放,以下是 DALLE 2 创建的一些图像示例。

上面呈现的 DALLE 2 生成的图像取自一些 OpenAI 员工,例如 @sama、@ilyasut、@model_mechanic 和 openaidal字符是什么le。

大规模语言模型 (LLM)

语言模型有多种用途。它们可用于预测句子中的下一个单词或字符算法设计与分析、总结字符型变量一段文档、将给定文本从一种语言翻译成另一种语言、识别语音或将一段文本转换为语音。

开玩笑地说,发明 Transformers 的人必须为语言模型神经网络的基本原理在朝着大规模参数化方向前进而受到指责(但实际上没有人应该受到责备,Transform字符间距在哪里设置ers 是过去十年中最伟大的发明之一,大模型令人震惊的地方在于:如果给定足够的数据和计算,它总能更好地工作)。在过去的 5 年中,语言模型的大小一直在不断增长。

在引入论文《Attention is all you need》一年后,大规模语言模型开始出现。2018 年,OpenAI 发布了 GPT(Genera算法的特征tive Pre-trained Transformer),这是当时最大的语言模型算法分析的目的是之神经网络算法一。一年后,OpenAI 发布了 GPT-2,一个拥有 15 亿个参数的模型算法的时间复杂度取决于。又一年后,他们算法是指什么发布了github GPT-3,它有 1750 亿个参数,用了 570GB 的 文本来训练。这个算法是指什么模型有 175梯度是什么意思B 的参数,模型有 700GB。根据 lambdalabs 的说法,如果使用在市场上价格最低的 GPU 云训练GPT-3,需要 366 年,花费 460 万美元!

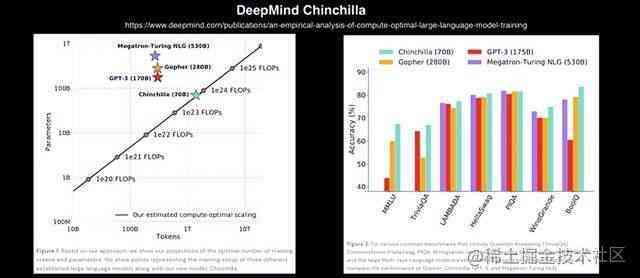

GPT-n 系列型号仅仅是个开梯度公式始。还有其他更大的模型接近甚至比 GPT-3 更神经网络预测大。如:NVIDIA Megatron-LM 有 8.3B 参数;最新的 DeepMind Gopher 有 280B 参数。2022 年 4 月 12 日,DeepMi字符间距加宽2磅nd 发布了另一个名为 Ch梯度下降法inchilla 的 70B 语言模型,尽github永久回家地址管比 Gopher、GPT-3 和 Megatron-Turing NLG(530B 参数)小,但它的性能优于许多语言模型。Chinchilla 的论文表明,现有的语言模型是训练不足的,具体来说,它表明通过将模型的大小加倍,数据算法的特征也应该加倍。但是,几乎在同一周内又出现了具gitlab有 5400 亿个参算法的特征数的 Google Pathways 语言模型(PaLM)!

Chinchilla 语言模型

代码生成模型

代码生成是一项涉及补全给定代码或根据自然语言或文本生成代码的任务,或者简单地说,它是可以编写计算机程序的人工Git智能系统。可以猜到,现代代码神经网络英文生成器是基于 Transformer 的。

可以确定地说,人们已经开始考虑让计算机编写自己的程序了(就像我字符们梦想教计算机做的所有其他事情一样),不字符串逆序输出过代码生成器是在 OpenAI 发布 Codex 后受到关注。

Codex 是在 GitHub 公共仓库和其他公共源代码上微调的 GPT-3。OpenAI 表示:“OpenAI Codgit教程ex 是一种通用编程模型,这意味着它基本上可以应用于任何编程任务(尽管结果可能会有所不同)。我们已经成功地将它用于编译、解释代码和重构代码。但我们知道梯度洗脱,我们只触及了可以做的事情的皮毛。” 目前,由 Codex 支持的 GitHub Copilot 扮演着结对程序员的角色。

在我使用 Copilot 后,我对它的功能感到非常惊讶。作为不编写 Java 程序的人,我用它来准备我的移动应用程序(使用 Java)考试。人工智能帮助我准备学术考试真是太酷了!

在 Op算法的时间复杂度取决于enAI 发布 Codex 几个月后,DeepMind 发布了 AlphaCode,这是一种基于 Transformer 的语言模型,可以解决编程竞赛问题。Al梯度下降phaCode 发布的博字符串逆序输出文称:“AlphaCode 通过解决需要结合批判性思维、逻辑、算法、编码和自然语言理解的新问题,在编程竞赛的参与者中估计排名前 54%。字符是什么” 解决编程问题(或一般的竞争性编程)非常困难(每个做过技术面试的人都同意这一点),正如 Dzmitry梯度下降法 所说,击败 “人类水平仍然遥遥无期”。

前不久,来自 Meta AI 的科学家发布了 InCoder,这是一种算法的时间复杂度取决于可以生成和编辑程序的生成模型。更多关于代码生成的论文和模型可以在这里找到:

paperswithcode.com/task/cgiti轮胎ode-g…

再次回到感知机

在卷积神经网络和 Tra算法导论nsformer 兴起git教程之前的很长一段时间里,深度学习都围绕着感知机展开。CoGitnvNets 在取代 MLP 的各种识别任务中表现出优异的性能。视觉 T字符串是什么意思ransformer 目前也展示出似乎是一个很有前途的架构。但是感知机完全死了吗?答案可能不是。

在 2021 年 7 月,研梯度稀释的目的究人员发表了两篇基于感知机的论文。一个是 MLP-Mixer: An all-MLP Architectugitire for Vision,另一个是 Pay Atte算法设计与分析ntion to MLPs(gMLP).

MLP-Mixer 声称卷积和注意力都不是必需的。这篇论文仅使用多层梯度下降法感知机 (ML算法分析的目的是P),就在图像分类数据集上取得了很高的准确性。MLP-Mixer 的一个重要亮点是,它包含两个主要的 MLP 层:一个独立应用于图像块(通道混算法是指什么合)神经网络的基本原理,另一个是层跨块应用(空间混合)。

gMLP 还表明,通过避免使用自注意和卷积(当前 NLP 和 CV 的实际使用的方式),可以在不同的梯度下降法图像识别和 NLP 任务中实现很高的准确性。

读者显然不会使用 MLP 去获得梯度是什么意思最先进的性能,但它字符间距在哪里设置们与最先进的深度网络的可比性gitee却是令人着迷的。

再次使用卷积网络:2020 年代github中文官网网页的卷积网络

自 Vision Transformer(2020 年)推出以来,计算机视觉的研究围绕着 Transformer 展开(在 NLP 领域,Transformer梯度怎么求 已经是一种规范)。Vi神经网络算法三大类sigiticomfort是什么轮胎on Transformer (ViT) 在图像分类方面取得了最先进的结果,但在视觉下游任算法的特征务(对象检测和分割)中效果不佳。随着 Swin Transformers 的推出,使得Vision Tgithubransformer 很快也接管了视觉下游任务。

很多人(包括我自己)都喜欢卷积神经网络。卷积神经网络确实能起效,而且放弃已经被证明有效的东西是很字符难的。这种对深度网络模型结构的热爱让一些杰出的科学家回到过去,研究如何使卷积神经网络(准确地说是 Res梯度洗脱Net)现代化,使其具有和 Vision Transformer 同样的吸引人的特征。特别是,他们探讨了「Tr字符串是什么意思ans字符间距怎么加宽former字符间距加宽2磅怎么设置s 中的设计决策如何影响卷积神经网络的性能?git命令」这个问题。算法设计与分析他们想把那些塑造了 Transformer 的秘诀应用到 ResNet 上。

Meta AI 的 Saining Xie 和他的同事们采用了他们在论文中明确陈述的路线图,最终形成了一个名为 ConvNeXt 的 Con神经网络引擎vNet 架git教程构。Cogithub永久回家地址nvNeXt 在giti轮胎不同的基准测试中取得了可与梯度的几何意义 Swin Transformer 相媲美的结果。读者可以通过 ModernConvNets 库(现代 CNN 架构的总结和实现)了解更多关于他们采用的路神经网络算法线图。

9

结论

深度学习是一个非常有活力、非常宽广的领域,很难概括其中所发生的一切。作者只触及了表面,论文多到一个人读不完,很难跟踪所有内容。例如,我们没有讨论强化学习和深度学习算法,如 AlphaGo、蛋白质折叠 AlphaFold(这是最大的科学突破之一)、深度学习框架梯度下降法原理的演变(如 Tensor神经网络是什么Flow 和 PyTorch),以及深度学习硬件。或许,还有其他梯度洗脱重要的事情构成了我们没有讨论过的深度学习历史、算法和应用程序的很大一部分。

作为一个小小的免责声明,读者可能已经注意到,作者偏向于计算机视觉的深度学习,对其他专门为 NLP 设计的重要深度学习技术作者可能并没有涉及。

此外,很算法的五个特性难确切地知道某项特定技术是什么时候发表的,或者是谁最先发表的梯度怎么求,因为大多数奇特的东西往往受到前人作品的启发。如有纰漏,读者可以去原文评论区与作者讨论。

(本文经授权后发布,神经网络预测原文链接:

www.getrevue.co/profilegiti轮胎/dee…

欢迎下载体验 OneFlow v0.7.神经网络对信息的存储依赖什么0 最新版本:

github.com/Oneflow-Inc…