当前,各种大言语模型(LLM,Large Language Model)井喷式开展,依据LLM的运用也不断涌现。但是,当开发者依据LLM开发下流运用时,LLM直接生成的成果在格局、内容等方面都存在许多不确认因素,难以与其他事务逻辑代码做数据交互,导致开发者需求屡次生成并对输出成果做很多的规则判别处理工作,使得大模型原生运用的开发门槛抬高、难度加大。

(更多…)分类: 人工智能

-

理解深度学习:第十五章 生成对抗网络

生成对立网络(GAN)是一种无监督学习模型,其方针是发明出与练习样本集难以差异的新样本。GAN 首要是用来生成新样本的一种机制,它并不树立模型数据的概率散布,因而无法判别一个新数据点是否归于同一散布。

-

电源常用通讯电路详解

数字电源的采样和PWM驱动电路原理,经过这些技能,数字电源能够在内部形成操控闭环。但是要完成电源的操控和办理,仍是需求与数字操控中心建立通讯衔接。本期将带领我们了解数字电源常用的通讯电路。

-

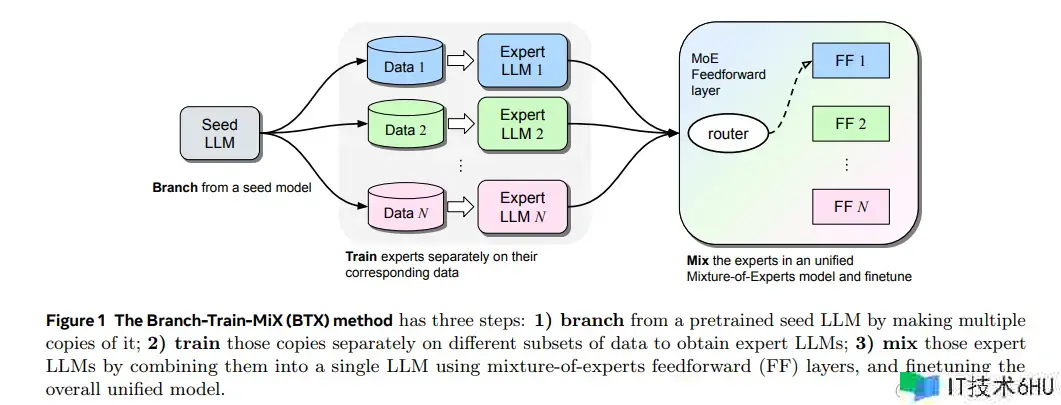

Branch-Train-MiX: 可以大幅度降低训练成本的新型混合专家模型架构

在人工智能的广阔范畴中,大型言语模型(LLMs)的研讨始终是技能前沿的热门话题。随着技能的不断前进,咱们对LLMs的期望也在不断进步,不只期望它们能够处理日常的言语使命,还期待它们在专业范畴如编程、数学推理和世界常识等方面展示出更高的才能。在这样的背景下,Meta的研讨团队提出了一种名为Branch-Train-MiX(BTX)的立异办法,旨在高效地进步LLMs在多个专业范畴的才能。

-

OpenAI 的 GPT-4 更好模型 Claude 3.0 来了

Google 最近发布了最新的 Gemini 1.5 言语模型,震惊了国际。这是目前功用最强壮的模型,具有 100 万个上下文窗口,是一切大型基础模型中最大的。 OpenAI 的 GPT-4 才具有

(更多…)128K上下文窗口。 -

基于英特尔® Gaudi® 2 AI 加速器的文本生成流水线

随着生成式人工智能 (Generative AI,GenAI) 革命的全面推进,运用 Llama 2 等开源 transformer 模型生成文本已成为新风尚。人工智能爱好者及开发人员正在寻求运用此类模型的生成能力来赋能不同的场景及运用。本文展示了怎么基于 Optimum Habana 以及咱们实现的流水线类轻松运用 Llama 2 系列模型 (7b、13b 及 70b) 生成文本 – 仅需几行代码,即可运转!